Mình bị lỗi khi sử dụng FlinkKafkaConsumer

Mình có sử dụng 2 consumer connect tới cùng 1 topic, 1 group.id, 2 partitions

Có 5 message Partition1 (m1, m2), Partition2 (,m3, m4, m5)

Issue:

Consumer1: Nhận được 5 messages m1...m5

Consumer2: Nhận được 5 messages m1....m5

Expect:

Consumer1: Nhận được 2 message m1, m2

Consumer2: Nhận được 2 message m3, m4, m5

v-model là 2-way data binding nhé bạn, khi data thay đổi thì value sẽ thay đổi (trên UI sẽ thấy cập nhật), và chiều ngược lại khi cập nhật UI (khi user gõ input) thì data cũng thay đổi theo

còn nếu bạn bind trực tiếp vào value thì chỉ có 1 chiều là: data thay đổi -> value cập nhật, chiều ngược lại khi user gõ làm thay đổi value thì data ko đổi

Cảm ơn bạn Bụng Rỗng @zzz . Bài viết rất hay! Mình có mấy điều thắc mắc trong bài viết của bạn:

Theo Python codes trên máy tấn công (kali) của bạn là version 2.xx. Hiện tại python đã lên 3.x (3.0 release từ năm 2008, bài viết của bạn là 12/2022). Ngoài vấn đề liên quan đến hàm print thì có 2 vấn đề cần giải quyết:

Lệnh s.send(buffer) sẽ ko thực hiện được do nó yêu cầu byte_type, còn buffer là string.

Nếu ta convert buffer từ string sang byte (dùng bytes(buffer,encode()) hoặc buffer.encode() ) thì sẽ không lọc được badchars (ko lọc được từ "\x8x")) do quá trình encode ko phù hợp.

Toàn bộ quá trình khai thác đòi hỏi người tấn công phải lấy thông tin trên cả máy attack và máy target để cuối cùng có được shell. Điều này ko thực tế nếu ta ko giám sát đc gì trên máy target và đòi hỏi quá trình gather chỉ có ở máy attack. Vậy làm thế nào (về mặt methology) để gather và exploit lỗ hổng buffer overflow với một dịch vụ khác nếu không phải là sync breeze v10.0.28 ?

Hình như ngay từ đầu bạn không làm rõ tác dụng của đoạn mã "\x90"*16 trong công thức:

inputBuffer = "A" * EIP + "BBBB" + "\x90" * 16 + Shellcode

THẢO LUẬN

@Sauancut bạn có thể cho mình mượn account để test được không tại mình có liên hệ vnpay mà họ chỉ gửi link chứ không cấp.

Em mới làm SEO các bác cho em xin ké với ạ https://romdesign.vn/

@rockman88v nếu nó không tạo PV thì làm sao xử lý hả bác?

hi, bạn có thể đóng gói hoàn chỉnh giúp mình ko? note giúp mình qua mail nhé

Mình bị lỗi khi sử dụng FlinkKafkaConsumer Mình có sử dụng 2 consumer connect tới cùng 1 topic, 1 group.id, 2 partitions Có 5 message Partition1 (m1, m2), Partition2 (,m3, m4, m5) Issue: Consumer1: Nhận được 5 messages m1...m5 Consumer2: Nhận được 5 messages m1....m5 Expect: Consumer1: Nhận được 2 message m1, m2 Consumer2: Nhận được 2 message m3, m4, m5

Cấu hình String kafkaBootstrapServers = config.get(SOURCE_KAFKA_BOOTSTRAP_SERVERS); String kafkaGroupId = config.get(SOURCE_KAFKA_GROUPID); String topic = config.get(SOURCE_KAFKA_TOPIC);

Properties properties = new Properties(); properties.setProperty("bootstrap.servers", kafkaBootstrapServers); properties.setProperty("group.id", kafkaGroupId);

properties.setProperty("security.protocol", "SASL_SSL"); properties.setProperty("sasl.mechanism", "SCRAM-SHA-512"); properties.setProperty("ssl.endpoint.identification.algorithm", ""); properties.setProperty("ssl.truststore.location", config.get(SOURCE_KAFKA_TRUSTSTORE_LOCATION)); properties.setProperty("ssl.truststore.password", config.get(SOURCE_KAFKA_TRUSTSTORE_PASS)); properties.put("sasl.jaas.config", String.format("org.apache.kafka.common.security.scram.ScramLoginModule required username="kafkascram" password="%s";", config.get(SOURCE_KAFKA_TRUSTSTORE_PASS)));

FlinkKafkaConsumer<EventBase> kafkaConsumer = new FlinkKafkaConsumer<>(topic, new SimpleSyslogEventSchema(), properties); kafkaConsumer.setStartFromGroupOffsets(); return kafkaConsumer;

"nên mình sẽ dành 1 bài để nói về việc quản lý model và làm sao để deploy lên production nhé"

Chưa thấy bài này à bạn!!!

😁😁😁

cảm ơn bạn, do lời giải mình dùng ARGF.read nó ko lấy được param input á, mình đổi lại gets.chomp oki nè

Khét đấy vương

v-model là 2-way data binding nhé bạn, khi data thay đổi thì value sẽ thay đổi (trên UI sẽ thấy cập nhật), và chiều ngược lại khi cập nhật UI (khi user gõ input) thì data cũng thay đổi theo

còn nếu bạn bind trực tiếp vào value thì chỉ có 1 chiều là: data thay đổi -> value cập nhật, chiều ngược lại khi user gõ làm thay đổi value thì data ko đổi

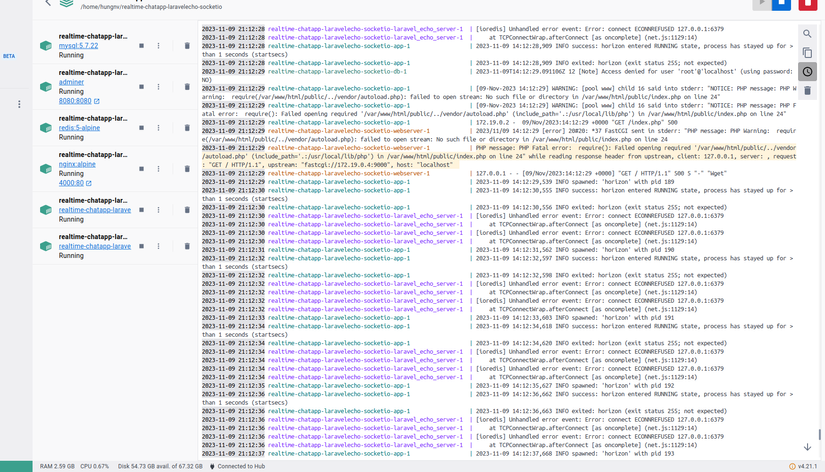

@hungngu lỗi rõ quá kìa e ơi, ko connect đc tới Redis

e đang chạy docker sao e connect tới redis bằng

127.0.0.1??nó phải là tên service name chứ:

redis:6379check lại file

.envcủa e nhé, đảm bảoREDIS_HOST=redisphần php của em bị thông báo như này ạ

Cảm ơn bạn Bụng Rỗng @zzz . Bài viết rất hay! Mình có mấy điều thắc mắc trong bài viết của bạn:

Cảm ơn bạn chủ thớt!!!

okie e nhé

Nếu bạn dùng AWS thì hiện có AWS Data Migration Service(AWS DMS) có thể giúp bạn vụ này theo giới thiệu. Bạn có thể thử

Thêm Propagation.REQUIRES_NEW để tránh lặp vô hạn có vẻ không đúng về Propagation.REQUIRES_NEW rồi

@macbmw bạn gõ xong ấn enter là được nhé

Em chưa đọc nhưng hứa sẽ đọc vì kiểu gì bài cũng sẽ chất lượng kkk