Ngăn AI nói nhảm: 7 cách để giảm thiểu ảo giác của LLM

Khi AI phát triển với tốc độ chóng mặt, việc tạo ra thông tin sai lệch bởi các Mô hình Ngôn ngữ Lớn (LLM) — thường được gọi là Ảo giác AI — vẫn là một rào cản lớn đối với các nhà phát triển và đội ngũ doanh nghiệp. Hiện tượng này xảy ra khi một mô hình cung cấp các sự thật không chính xác, các điều khoản bịa đặt hoặc lời khuyên phi logic với sự chắc chắn tuyệt đối. Trong các lĩnh vực khắt khe như y tế, tài chính hoặc luật pháp, những sai sót như vậy có thể dẫn đến hậu quả tai hại.

Để xây dựng các hệ thống AI đáng tin cậy, điều cần thiết là phải hiểu nguyên nhân gốc rễ của ảo giác và thực hiện các biện pháp hạn chế kỹ thuật có mục tiêu.

Tại sao các mô hình lại gặp ảo giác?

Ảo giác bắt nguồn chủ yếu từ logic cơ bản của LLM. Các mô hình hiện tại về bản chất là các công cụ dự đoán chuỗi xác suất; chúng đoán từ tiếp theo dựa trên các mẫu thống kê tìm thấy trong dữ liệu đào tạo của chúng. Chúng thiếu suy luận logic thực sự hoặc cơ chế kiểm tra thực tế — chúng chỉ đơn giản là tạo ra văn bản nghe có vẻ hợp lý thông qua xác suất toán học.

Nếu dữ liệu đào tạo chứa các định kiến, sai sót hoặc nội dung lỗi thời, mô hình sẽ hấp thụ những khuyết điểm này. Hơn nữa, các mô hình thường có xu hướng "muốn làm hài lòng". Khi đối mặt với khoảng cách tri thức, chúng hiếm khi thừa nhận là mình không biết, mà chọn cách bịa đặt thông tin để lấp đầy khoảng trống.

Cách giảm thiểu ảo giác AI

Bằng cách tối ưu hóa kiến trúc hệ thống và kỹ thuật prompt, bạn có thể giảm đáng kể tần suất xảy ra ảo giác.

1. Áp dụng Tạo Tăng cường Truy xuất (RAG)

Đây hiện là một trong những giải pháp hiệu quả nhất. Với RAG, mô hình không còn chỉ dựa vào bộ nhớ trong của nó. Thay vào đó, trước tiên nó sẽ truy xuất các tài liệu liên quan từ một cơ sở tri thức bên ngoài đáng tin cậy và sau đó trả lời dựa trên ngữ cảnh cụ thể đó. Điều này chuyển quy trình làm việc của mô hình từ một "cuộc thi cử đóng sách" sang "cuộc thi cử mở sách", đảm bảo kết quả đầu ra dựa trên bằng chứng có thể kiểm chứng.

2. Sử dụng Gọi Công cụ (Tool Calling)

Đối với các truy vấn liên quan đến dữ liệu thời gian thực, thông tin động hoặc các phép tính phức tạp, nhiệm vụ nên được bàn giao cho các công cụ chuyên dụng. Khi kiểm tra giá cổ phiếu trực tiếp, thời tiết hoặc hồ sơ cơ sở dữ liệu, mô hình sẽ ngừng dự đoán và thay vào đó kích hoạt một API để tìm nạp dữ liệu xác định. Tại đây, mô hình chỉ chịu trách nhiệm sắp xếp ngôn ngữ, bỏ qua các lỗi do bộ nhớ mờ nhạt gây ra.

3. Cho phép mô hình thừa nhận rõ ràng là mình không biết

Kết hợp các hướng dẫn cụ thể trong prompt của bạn để bảo mô hình trả lời "Tôi không chắc" hoặc "Không tìm thấy thông tin" khi đối mặt với dữ liệu không đầy đủ hoặc không chắc chắn. Điều này loại bỏ áp lực buộc mô hình phải bịa đặt nội dung chỉ để hoàn thành nhiệm vụ. Ví dụ: khi phân tích một báo cáo M&A phức tạp, bạn có thể hướng dẫn mô hình nêu rõ nếu thiếu bằng chứng cần thiết.

4. Bắt buộc trích dẫn trực tiếp

Khi xử lý các tài liệu dài hoặc các quy định pháp lý, hãy yêu cầu mô hình trích dẫn nguyên văn từ văn bản nguồn trước khi thực hiện bất kỳ phân tích nào. Kỹ thuật neo giữ này ngăn ngừa sự sai lệch ngữ nghĩa trong quá trình diễn giải. Thực hiện tóm tắt hoặc kiểm toán dựa trên các trích dẫn này sẽ giúp nâng cao đáng kể tính chặt chẽ của kết quả đầu ra.

5. Thiết lập việc ghi nhận nguồn và kiểm toán

Yêu cầu mô hình trích dẫn nguồn cho mọi tuyên bố thực tế. Sau khi nội dung được tạo, một bước xác minh bổ sung có thể được thêm vào để mô hình kiểm tra xem mỗi tuyên bố có văn bản gốc tương ứng trong tài liệu tham khảo hay không. Nếu không tìm thấy bằng chứng hỗ trợ, tuyên bố đó phải được rút lại. Cơ chế phản hồi có thể kiểm toán này giúp tăng tính minh bạch.

6. Tinh chỉnh (Fine-tuning) và RLHF với dữ liệu chất lượng cao

Chuyên môn của một mô hình phụ thuộc vào chất lượng dữ liệu đào tạo của nó. Tinh chỉnh trên các tập dữ liệu chuyên nghiệp được tuyển chọn, không có tạp âm sẽ cải thiện sự nắm bắt của mô hình đối với logic cụ thể của ngành. Đồng thời, sử dụng Học tăng cường từ phản hồi của con người (RLHF) cho phép các chuyên gia con người chấm điểm độ chính xác của kết quả đầu ra, hướng dẫn mô hình tránh cách diễn đạt dễ dẫn đến ảo giác.

7. Lọc kết quả đầu ra và Đánh giá độ tin cậy

Thêm một lớp xác thực xử lý hậu kỳ tự động trước khi kết quả được hiển thị cho người dùng cuối. Hệ thống có thể gán một số điểm dựa trên "mức độ chắc chắn" của mô hình về câu trả lời. Nếu điểm tin cậy giảm xuống dưới một ngưỡng nhất định, nó có thể tự động kích hoạt quá trình xem xét thủ công hoặc từ chối xuất câu trả lời. Cơ chế lọc này sẽ chặn phần lớn các kết quả tạo ra chất lượng thấp.

Trong kỷ nguyên phát triển AI nhanh chóng này, các nhà phát triển không nên né tránh AI chỉ vì vấn đề ảo giác. Một cách tiếp cận hợp lý hơn là sử dụng các phương tiện kỹ thuật để hạn chế mô hình và giảm thiểu sai sót. Thị trường hiện cung cấp vô số lựa chọn, từ các trợ lý lập trình AI tăng cường hiệu quả đến các LLM cục bộ tập trung vào quyền riêng tư.

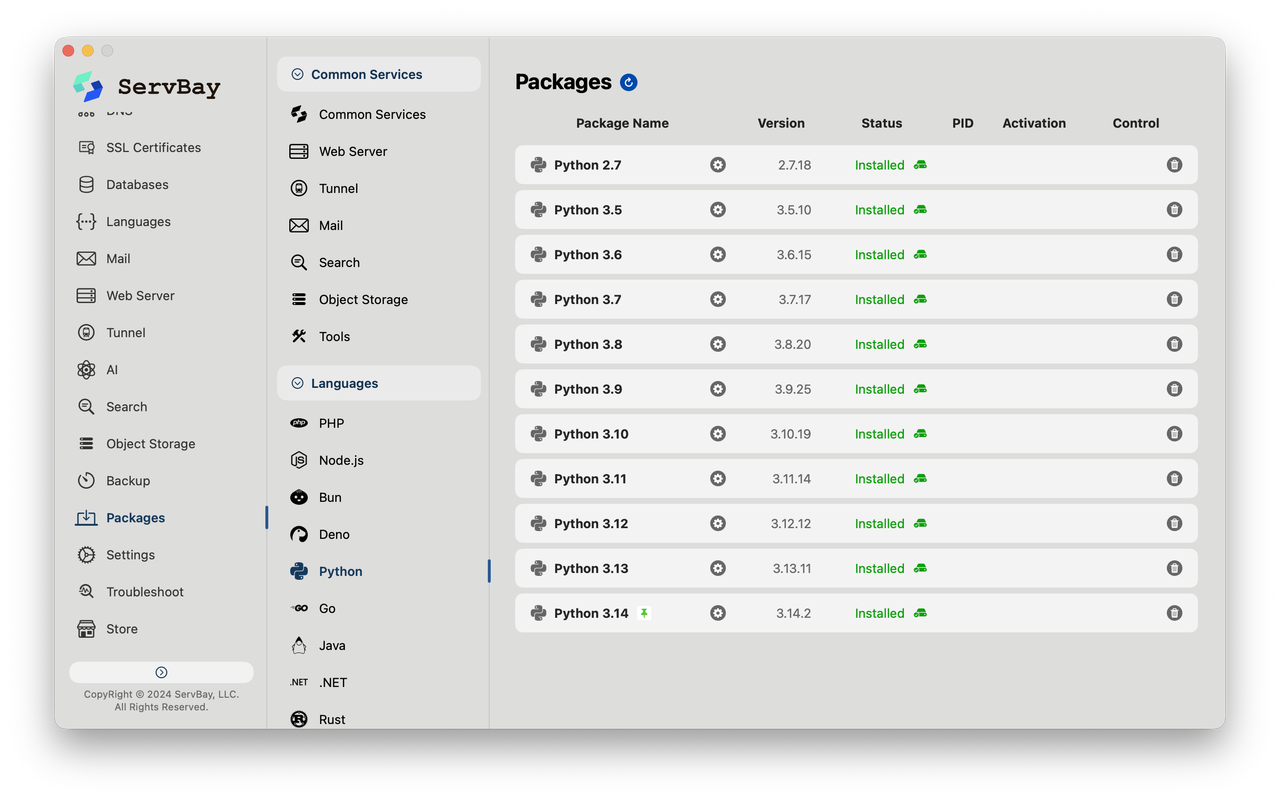

Việc chạy các công cụ AI này thường yêu cầu môi trường cục bộ cụ thể. Ví dụ: các trợ lý lập trình AI phổ biến thường cần môi trường Python hoặc Node.js để hoạt động bình thường. ServBay cung cấp một giải pháp cực kỳ tiện lợi, hỗ trợ cài đặt Python chỉ với một cú nhấp chuột và môi trường Node.js. Đối với các nhà phát triển cần chuyển đổi giữa nhiều dự án, ServBay cho phép chuyển đổi giữa các phiên bản môi trường khác nhau chỉ với một cú nhấp chuột, loại bỏ hoàn toàn cơn đau đầu về xung đột môi trường.

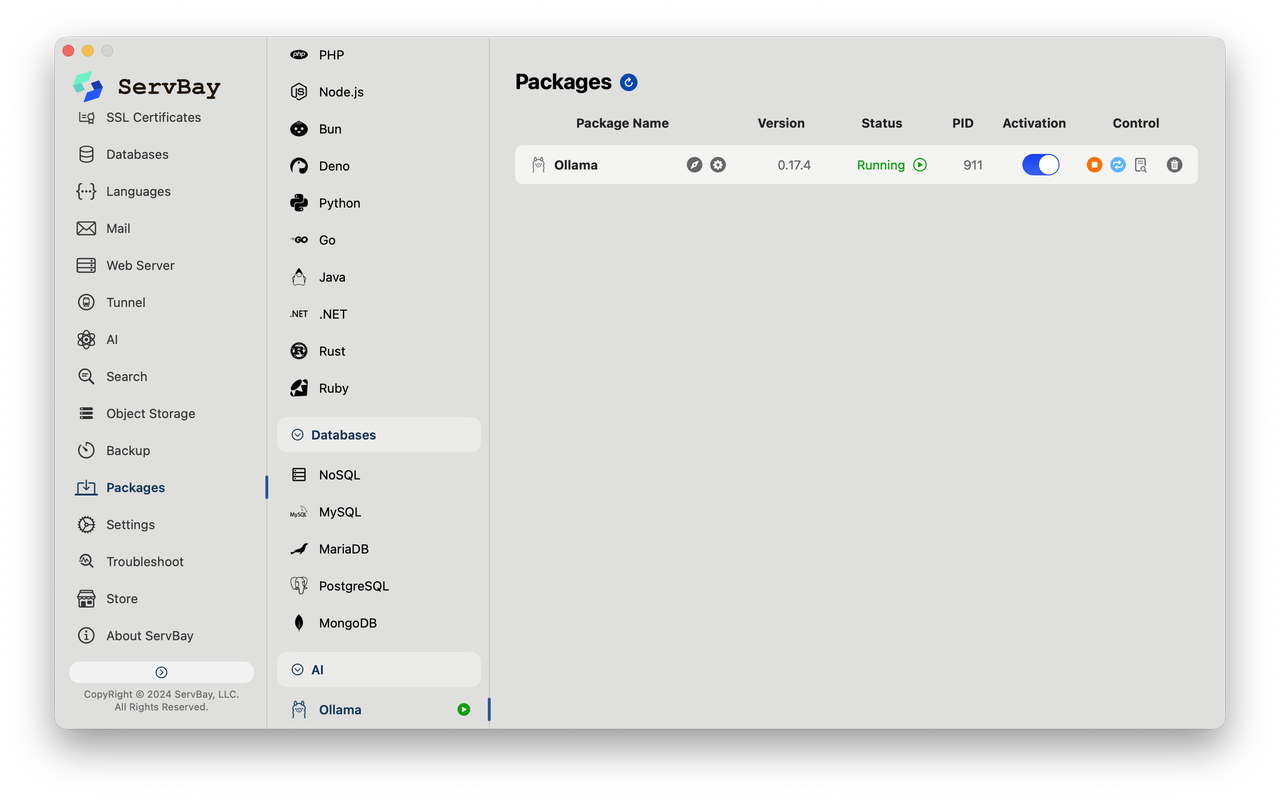

Nếu bạn có yêu cầu cực kỳ cao về quyền riêng tư dữ liệu, chạy LLM cục bộ là lựa chọn ưu việt. ServBay tích hợp khả năng cài đặt Ollama chỉ với một cú nhấp chuột, cho phép các nhà phát triển dễ dàng khởi chạy các mô hình mã nguồn mở phổ biến như Llama 3 và Qwen ngay trên máy cục bộ của họ.

Được kết hợp với giao diện quản lý tích hợp của ServBay, các nhà phát triển có thể nhanh chóng thực hiện gỡ lỗi RAG cục bộ và xác thực mô hình, tối ưu hóa hiệu suất hệ thống mà không làm rò rỉ dữ liệu nhạy cảm.

Kết luận

Ảo giác là "tội lỗi nguyên thủy" của LLM, nhưng nó không phải là một hố sâu không thể vượt qua. Trong thời đại AI chọn lọc tự nhiên này, độ chính xác chính là huyết mạch. Hãy từ chối kết quả đầu ra tầm thường và sự phồn vinh giả tạo. Hoặc là giải quyết vấn đề ảo giác, hoặc là bị thị trường đào thải — không có con đường ở giữa.

All rights reserved