GLM-5 Nâng Tầm AI Mã Nguồn Mở: Giấc Mơ "Công Ty Một Người" Đã Ở Rất Gần

Trước đây, tôi từng nghĩ đa số các model AI mã nguồn mở (Open-source) chỉ mang tính chất "đồ chơi" hoặc để làm research. Nếu muốn thực sự làm việc, viết logic phức tạp, tôi vẫn phải ngậm ngùi đóng "phí bảo kê API" cho các ông lớn công nghệ (như OpenAI hay Anthropic).

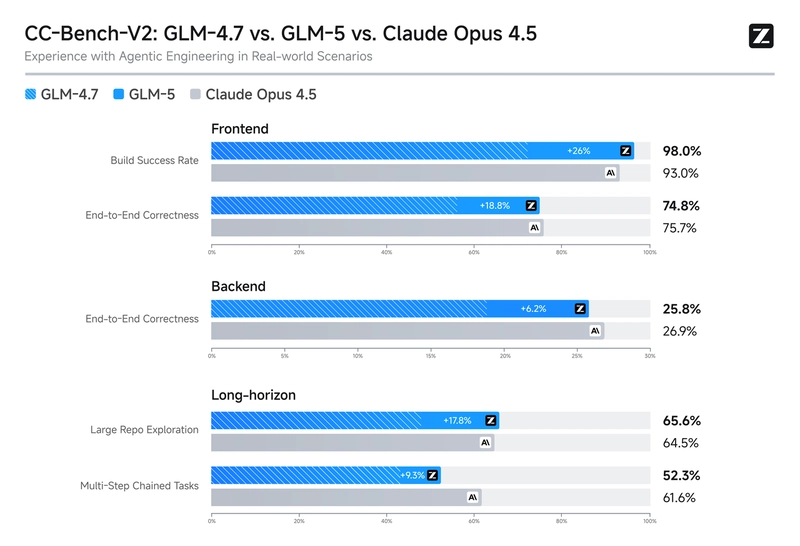

Sự ra mắt của GLM-5 không chỉ đơn thuần là việc tăng số phiên bản (v++). Nó trực tiếp kéo các model mã nguồn mở từ phân khúc "đồ chơi" lên thẳng cấp độ "nhân viên cứng".

Sau khi chạy thử một loạt bài test, tôi nhận ra một sự thật chấn động: những công việc vặt vãnh mà trước đây tôi phải thuê người làm — hoặc tự mình thức trắng đêm để cày — giờ đây hoàn toàn có thể giao phó cho model này.

Tại Sao GLM-5 Lại Phá Vỡ Nhận Thức Của Tôi?

Với 744B tham số (kích hoạt 40B) và được pre-train trên 28.5T tokens, GLM-5 giải quyết được hai nỗi đau lớn nhất khi dùng AI để lập trình: "não cá vàng" (trí nhớ kém) và thiếu khả năng suy luận logic.

1. Nó Không Còn Là "Cỗ Máy Giải Toán" Thuần Túy

Khi đánh giá model, mọi người thường thích xem nó giải các bài toán thi Olympic. Nhưng nói thật đi, có mấy ai dùng toán Olympic trong công việc hàng ngày? Thứ tôi cần là một con AI giúp tôi lên kế hoạch và xử lý task.

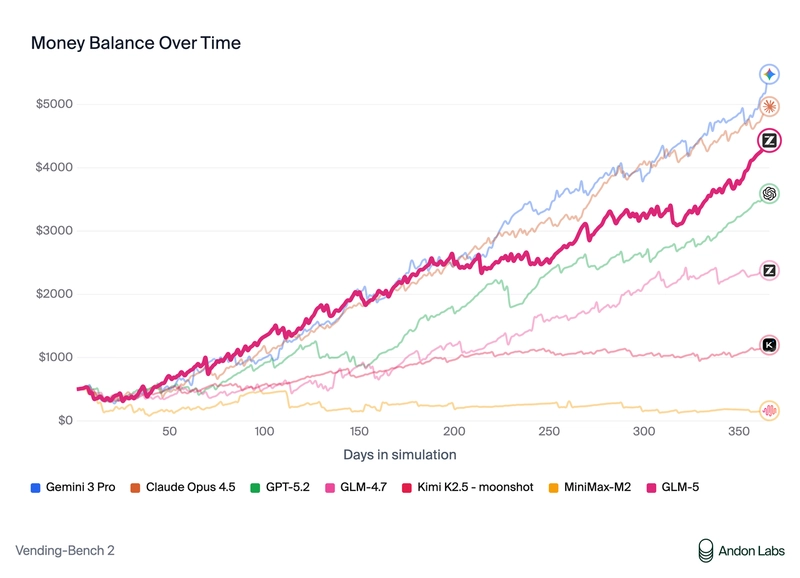

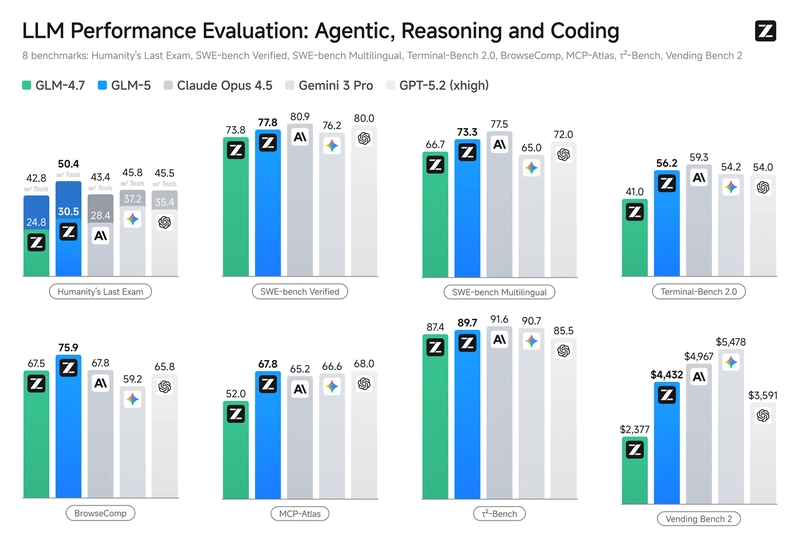

Và đây là lúc màn trình diễn của GLM-5 trên benchmark Vending Bench 2 khiến tôi kinh ngạc. Đây là một bài test cực kỳ "biến thái", yêu cầu model phải quản lý một công ty máy bán hàng tự động giả lập trong suốt một năm trời.

- Đa số các model open-source: "Tử trận" ngay từ những ngày đầu. Chúng hoàn toàn mất phương hướng về hàng tồn kho và dòng tiền.

- GLM-5: Không những sống sót qua 1 năm mà cuối cùng tài khoản còn dư 4.432 USD.

Thành tích này tạo ra một khoảng cách biệt lập hoàn toàn trong thế giới open-source, bám đuổi sát nút gã khổng lồ mã nguồn đóng Claude Opus 4.5. Nếu bạn đưa GLM-5 vào luồng nghiệp vụ (business workflow), nó thực sự sở hữu năng lực quản lý tài nguyên và lập kế hoạch dài hạn.

2. Từ Việc "Sinh Văn Bản" Đến "Bàn Giao Công Việc"

Điều phiền toái nhất khi dùng LLM trước đây là gì? Nó "ọc" ra cho bạn một đống text định dạng Markdown, và bạn vẫn phải tự hì hục copy, paste rồi tự dàn trang.

Điểm khiến tôi bất ngờ nhất ở GLM-5 là khả năng thấu hiểu bối cảnh văn phòng. Nó có thể biến các kết quả suy luận phức tạp thành các file .docx, .pdf và thậm chí là .xlsx để xuất ra trực tiếp.

- Viết tài liệu PRD? Nó quăng lại cho bạn một file Word định dạng chuẩn chỉ.

- Làm phân tích tài chính? Nó ném cho bạn một file Excel có sẵn cả công thức.

Đây mới chính là công cụ tối ưu năng suất. Nó loại bỏ hoàn toàn khoảng thời gian vô nghĩa dành cho việc căn chỉnh format và tổng hợp tài liệu.

3. Tối Ưu Chi Phí & Tăng Cường Hiệu Năng

Bạn có thể sẽ thắc mắc: với lượng tham số khổng lồ như vậy, chạy nó có chậm như rùa bò không?

GLM-5 sử dụng công nghệ DeepSeek Sparse Attention (DSA), giúp model chỉ tập trung vào những thông tin cần thiết nhất, dồn lực tính toán vào đúng "lưỡi dao". Kết hợp với kiến trúc học tăng cường slime, nó giải quyết được bài toán "alignment tax" (model càng train càng ngáo).

Kết quả? Mật độ logic cực cao và không có một chữ nào nói nhảm.

Triển Khai Local: Đừng Vật Lộn Với Môi Trường

Nghe đến đây, chắc hẳn nhiều anh em đang ngứa ngáy muốn chạy thử ở local. Dù sao thì, dữ liệu nằm trong máy mình vẫn là an tâm nhất.

Tuy nhiên, một model ở tầm cỡ GLM-5 có những yêu cầu cực kỳ khắt khe về môi trường Python và các thư viện phụ thuộc. Tôi từng mất cả một ngày trời chỉ để giải quyết xung đột dependency của Python khi chạy một model lớn. Đến cuối ngày, tâm lý suy sụp mà model thì vẫn chưa chạy lên được.

Để không đi vào vết xe đổ đó, lần này tôi dùng thẳng ServBay. Nếu bạn nghĩ mấy tool dạng này chỉ dành cho người mới (newbie), thì bạn nhầm to rồi — nó dành cho những developer thực sự biết quý trọng thời gian của mình.

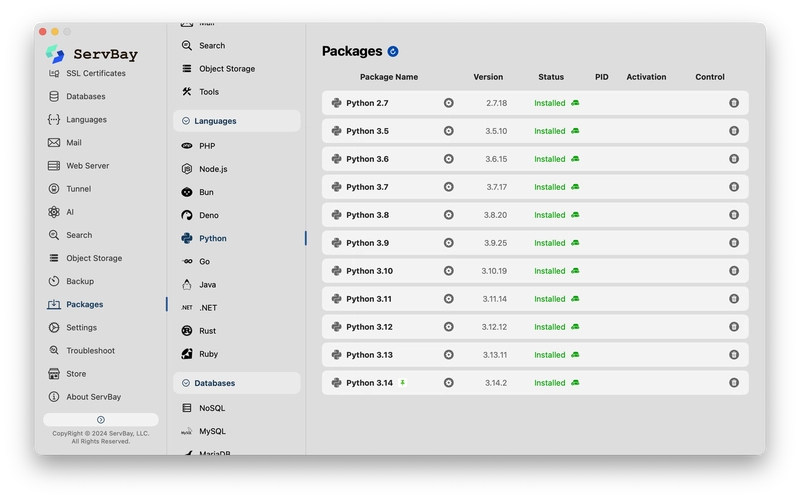

Để chạy GLM-5, bạn cần một phiên bản Python cụ thể và phải cấu hình vLLM hoặc SGLang. Nếu cố đấm ăn xôi làm thẳng trên hệ điều hành máy thật, bạn rất dễ làm "nát" luôn môi trường của các dự án hiện tại. Với ServBay, việc cấu hình môi trường Python chỉ tốn đúng một cú click chuột. Nó lập tức tạo cho tôi một sandbox Python 3.10+ hoàn toàn cách ly và sạch sẽ.

Mọi thứ đơn giản đến vậy đấy. Trong cái sandbox sạch sẽ này, tôi chạy lệnh cài đặt:

pip install -U vllm --pre --index-url https://pypi.org/simple --extra-index-url https://wheels.vllm.ai/nightly

Không có lỗi. Không có những dòng log đỏ rực. Thành công ngay từ lần chạy đầu tiên. Chỉ riêng số thời gian tiết kiệm được ở bước này cũng đủ để tôi đọc đi đọc lại tài liệu API của GLM-5 đến hai lần.

Lời Kết

Nếu bạn muốn nhìn thử xem phong cách làm việc trong tương lai sẽ trông như thế nào, hãy thử GLM-5.

Nó không phải là kiểu đồ chơi khiến bạn "Ồ" lên một tiếng rồi tắt tab. Nó là kiểu công cụ mà chỉ sau một lần sử dụng, bạn sẽ nghiêm túc cân nhắc đến việc... hoãn kế hoạch tuyển dụng thêm trợ lý.

Thực sự rất đáng để trải nghiệm.

All rights reserved