BÀI 7 — VECTOR CALCULUS (Gradient – nền tảng để AI “học”)

🎯 Mục tiêu

Hiểu:

Đạo hàm là gì Gradient là gì Tại sao AI học được (gradient descent) 🧠 1. ĐẠO HÀM (Derivative) 📌 Ý nghĩa

👉 Đạo hàm = tốc độ thay đổi

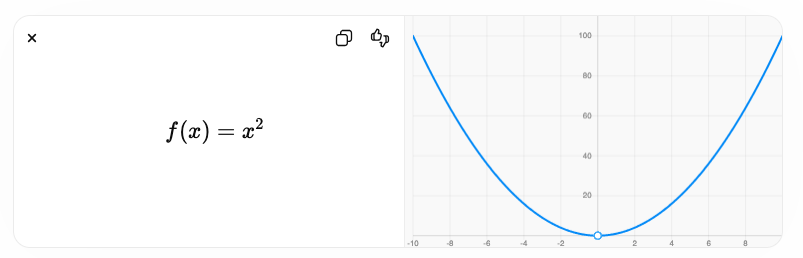

📌 Ví dụ

👉 đạo hàm:

👉 đạo hàm:

f(x)=2x

🎯 Ý nghĩa

x tăng → f(x) tăng nhanh thế nào

giúp tìm điểm tối ưu

🧠 2. GRADIENT (QUAN TRỌNG NHẤT)

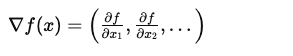

📌 Định nghĩa

🎯 Ý nghĩa

👉 Gradient = hướng tăng nhanh nhất của hàm

📌 Ví dụ

👉 gradient:

👉 gradient:

∇f=(2x,2y)

🧠 3. TRỰC GIÁC (RẤT QUAN TRỌNG)

👉 Hãy tưởng tượng:

bạn đứng trên núi gradient chỉ hướng leo lên nhanh nhất

👉 còn:

-gradient = đi xuống nhanh nhất 🔥 4. GRADIENT DESCENT (AI HỌC NHƯ THẾ NÀO) 📌 Công thức

x=x−η∇f(x)

🎯 Ý nghĩa x: tham số model η (eta): learning rate ∇f: gradient

👉 cập nhật để giảm lỗi

🧠 5. Ví dụ ML thật

Model:

y = ax + b

👉 Loss:

error = (y_pred - y_true)^2

👉 dùng gradient:

cập nhật a, b 🔥 6. TẠI SAO CÁI NÀY QUAN TRỌNG?

👉 Vì:

Neural Network = gradient descent Deep Learning = backpropagation 🧠 Insight level cao

👉 AI = tối ưu hàm:

minimize loss 🔥 BÀI TẬP ✍️ Bài 1 (cơ bản)

Tính đạo hàm:

✍️ Bài 2 (gradient)

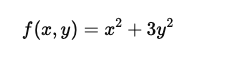

Cho:

👉 Tính gradient

✍️ Bài 3 (tư duy)

👉 Tại sao:

phải đi theo -gradient mà không phải gradient? ✍️ Bài 4 (level AI)

👉 Nếu learning rate quá lớn thì sao?

🚀 Nếu bạn hiểu bài này

👉 bạn đã hiểu:

cách AI học cách training model nền tảng deep learning

All rights reserved