[Open Source] #51 - Mem0: Xây dựng "Bộ não" dài hạn cho AI Agent với kiến trúc Hybrid Vector-Graph Memory và LLM-driven Extraction

Xây dựng các ứng dụng AI cá nhân hóa (Personalized AI) đang gặp phải một rào cản lớn: Sự ngắn hạn của bộ nhớ. Hầu hết các LLM hiện nay hoạt động theo cơ chế "stateless" – chúng quên sạch những gì đã nói ngay khi phiên làm việc kết thúc. Mặc dù RAG (Retrieval-Augmented Generation) đã giúp cải thiện phần nào, nhưng nó vẫn thiếu đi khả năng tự học hỏi và cập nhật thông tin theo thời gian thực.

Mem0 (đọc là Mem-zero) xuất hiện như một "lớp vỏ não" bổ sung, cung cấp khả năng lưu trữ ký ức dài hạn, thông minh và có tính nhất quán cao cho các AI Agent. Nếu Nakama là "vị cứu tinh" cho backend game, thì Mem0 chính là chìa khóa để biến AI từ một kẻ "não cá vàng" thành một trợ lý thực thụ hiểu rõ người dùng.

Github: https://github.com/mem0ai/mem0

🧠 1. Nền tảng công nghệ: Hybrid Memory Stack

Mem0 không chỉ đơn thuần là một database; nó là một hệ thống quản trị tri thức phức hợp, kết hợp những công nghệ hiện đại nhất:

- LLM-driven Extraction: Mem0 sử dụng các mô hình ngôn ngữ lớn (như GPT-4o) không phải để chat, mà để đóng vai trò một "bộ lọc" để trích xuất sự thật (fact extraction) từ các dòng hội thoại thô.

- Kiến trúc DB lai (Hybrid Database):

- Vector Databases (Qdrant, Pinecone, Chroma): Lưu trữ embedding để tìm kiếm ngữ nghĩa (semantic search), giúp AI tìm thấy những ký ức "có vẻ liên quan".

- Graph Databases (Neo4j, Memgraph): Xây dựng mối quan hệ thực thể. Ví dụ: Nếu bạn nói "Tôi làm việc tại OpenAI", Mem0 sẽ tạo một node "User" nối với node "OpenAI" qua cạnh "Làm việc tại".

- Multi-Platform SDK: Hỗ trợ cả Python và TypeScript, giúp tích hợp mượt mà vào cả backend xử lý dữ liệu lẫn frontend ứng dụng web.

🏗️ 2. Tư duy kiến trúc: Từ RAG tĩnh đến Stateful AI

Sự khác biệt lớn nhất của Mem0 so với các hệ thống RAG truyền thống nằm ở tư duy "Stateful AI":

- Bộ nhớ đa tầng (Multi-level Hierarchy):

- User Level: Ghi nhớ sở thích cốt lõi, dài hạn của từng cá nhân.

- Session Level: Giữ ngữ cảnh của cuộc hội thoại hiện tại.

- Agent Level: Lưu trữ các quy tắc và kinh nghiệm mà AI tự rút ra sau quá trình vận hành.

- Vòng lặp tự cải thiện (Self-Improving Loop): Không giống như RAG chỉ đọc dữ liệu có sẵn, Mem0 liên tục cập nhật ký ức. Mỗi tương tác mới là một cơ hội để hệ thống tinh chỉnh, ghi đè hoặc bổ sung vào kho tri thức cũ.

🔄 3. Các kỹ thuật "Pro-level" trong xử lý ký ức

-

Fact Extraction vs. Log Storage: Thay vì lưu hàng MB log chat (gây nhiễu và tốn token), Mem0 chỉ lưu các "Sự thật".

- Input: "Dạo này tôi hay thức khuya làm việc, chắc phải gọi thêm một ly cà phê đen không đường."

- Fact: "User thường xuyên thức khuya", "User thích cà phê đen", "User không dùng đường".

-

Conflict Resolution (Giải quyết mâu thuẫn): Đây là kỹ thuật khó nhất. Nếu hôm nay bạn nói "Tôi thích trà", nhưng ngày mai lại nói "Tôi ghét trà, tôi chỉ uống cafe", Mem0 sẽ sử dụng logic chấm điểm (scoring) và dấu mốc thời gian (timestamp) để cập nhật ký ức, đảm bảo AI không bị bối rối bởi các thông tin mâu thuẫn.

-

Asynchronous Processing (Xử lý bất đồng bộ): Việc trích xuất và lưu trữ ký ức được thực hiện ngầm (

async_mode=True). Điều này đảm bảo người dùng nhận được phản hồi từ AI ngay lập tức, trong khi bộ não của AI đang âm thầm "ghi nhớ" ở phía sau mà không gây ra độ trễ (latency).

⚖️ 4. So sánh chiến lược: Tại sao Mem0 vượt trội?

| Tiêu chí | Mem0 | Truyền thống (RAG) | Native LLM Memory |

|---|---|---|---|

| Độ chính xác | Cao (+26% so với mặc định) | Trung bình (Dễ bị nhiễu) | Thấp (Dễ bị ảo giác) |

| Chi phí Token | Tiết kiệm 90% (Chỉ lấy Fact) | Tốn kém (Gửi kèm Context lớn) | Rất tốn (Toàn bộ History) |

| Tính cá nhân hóa | Rất cao (Học theo thời gian) | Thấp (Dữ liệu tĩnh) | Ngắn hạn (Mất sau Session) |

| Tốc độ phản hồi | Nhanh hơn 91% | Chậm (Search Vector lớn) | Nhanh |

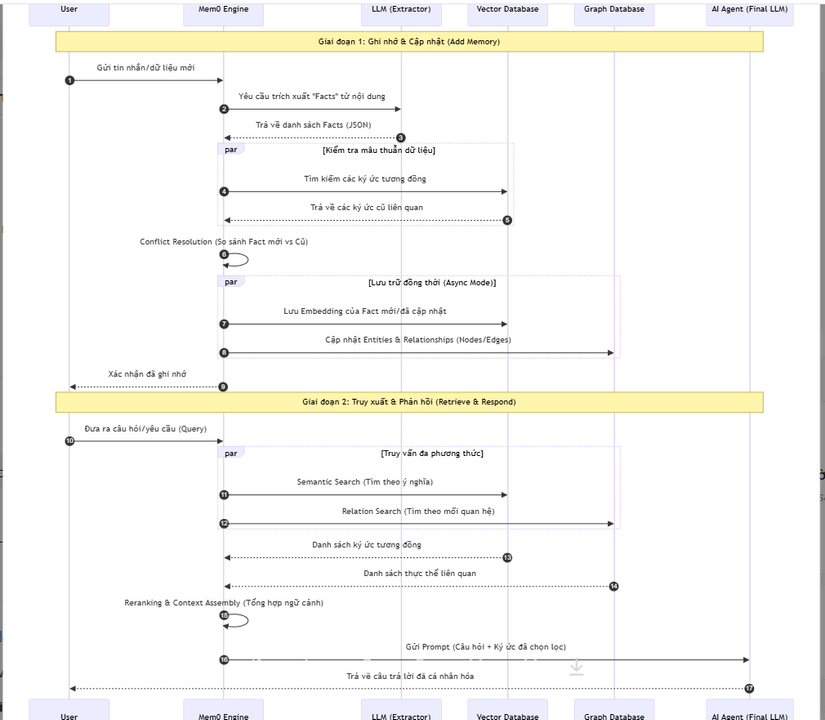

🚀 5. Workflow: Cách Mem0 vận hành trong thực tế

Sơ đồ luồng dữ liệu của Mem0 giúp chúng ta hình dung cách một thông tin thô trở thành một ký ức vĩnh cửu:

- Input: Nhận tin nhắn từ người dùng.

- Extraction: LLM trích xuất các "facts" quan trọng.

- Conflict Check: Đối soát với kho dữ liệu cũ để cập nhật hoặc ghi đè.

- Hybrid Storage: Lưu đồng thời vào Vector DB (để search nhanh) và Graph DB (để hiểu sâu).

- Retrieval: Khi người dùng hỏi, Mem0 truy xuất những ký ức liên quan nhất để "mớm" vào Prompt cho AI.

✅ Kết luận: Tương lai của AI nằm ở "Ký ức"

Mem0 không chỉ là một thư viện lưu trữ; nó là một bài học về Hệ quản trị tri thức động. Dự án chứng minh rằng để AI thực sự hữu ích, nó cần có khả năng "tiến hóa" cùng người dùng. Việc tách biệt lớp bộ nhớ ra khỏi lõi suy luận của LLM giúp chúng ta xây dựng được những hệ thống AI vừa nhẹ, vừa rẻ, lại vừa thông minh.

Đối với các kỹ sư AI và Backend, nghiên cứu Mem0 sẽ mở ra các góc nhìn về:

- Cách tối ưu hóa Context Window hiệu quả.

- Kỹ thuật kết hợp giữa Vector Search và Knowledge Graph.

- Tư duy xây dựng Stateful Agents trong một thế giới Stateless APIs.

Hy vọng bản phân tích này mang lại cho bạn những giá trị mới về kiến trúc AI hiện đại. Nếu thấy hay, đừng quên Upvote và Follow mình nhé!

All rights reserved