[Open Source] #27 - Cherry Studio AI Core: Nghệ thuật xây dựng Multi-model Runtime và Plugin Engine đột phá

Github: https://github.com/kangfenliu/cherry-studio

🛠️ 1. Nền tảng công nghệ: Vercel AI SDK và Sức mạnh của WASM

AI Core không chỉ đơn thuần là một trình bao bọc (wrapper) API; nó là một hệ điều hành thu nhỏ cho các mô hình ngôn ngữ lớn (LLM):

- Vercel AI SDK (Lõi trung tâm): Thay vì tự viết logic gọi API cho từng hãng (OpenAI, Anthropic, Google...), Cherry Studio tận dụng giao diện chuẩn hóa của Vercel AI SDK để xử lý streaming, gọi công cụ (tool calling) và xử lý lỗi đồng nhất.

- Dynamic Provider Loading: Hệ thống sử dụng Dynamic Imports để "lazy-load" các SDK. Code của từng nhà cung cấp chỉ được nạp vào bộ nhớ khi người dùng thực sự kích hoạt mô hình đó, giúp giảm 40-50% dung lượng gói (bundle size) khởi tạo.

- Pyodide & WASM: Điểm đột phá là khả năng thực thi Python trực tiếp trong trình duyệt thông qua WebAssembly. Điều này cho phép AI Core chạy các khối mã tính toán phức tạp ngay tại máy khách (Client-side) mà không cần server trung gian.

- Isolated Rendering: Sử dụng Shadow DOM để hiển thị kết quả Markdown và SVG (Mermaid, Graphviz). Kỹ thuật này giúp cô lập hoàn toàn CSS, đảm bảo mã lỗi hoặc mã độc từ AI không thể làm hỏng giao diện chính của ứng dụng.

🏗️ 2. Trụ cột kiến trúc: Model Factory và Runtime Executor

Hệ thống của AI Core được thiết kế theo tư duy Clean Architecture, tách biệt hoàn toàn giữa định nghĩa và thực thi:

Model Factory (Nhà máy khởi tạo)

Thay vì quản lý các lớp (class) phức tạp, AI Core sử dụng các Factory Function để tạo Model:

- Provider Registry: Quản lý tập trung các endpoint tương thích (DeepSeek, Groq, Local Ollama).

- Option Mapping: Tự động ánh xạ cấu hình đặc thù của từng hãng (ví dụ:

reasoning_effortcủa OpenAI o1 haytop_kcủa Gemini) về một chuẩn duy nhất.

Runtime Layer (Tầng thực thi)

Đây là nơi quản lý vòng đời của một Request AI. Nó không quan tâm bạn đang dùng model nào, nó chỉ tập trung vào việc: Điều phối Plugin, Quản lý Stream và Xử lý lỗi.

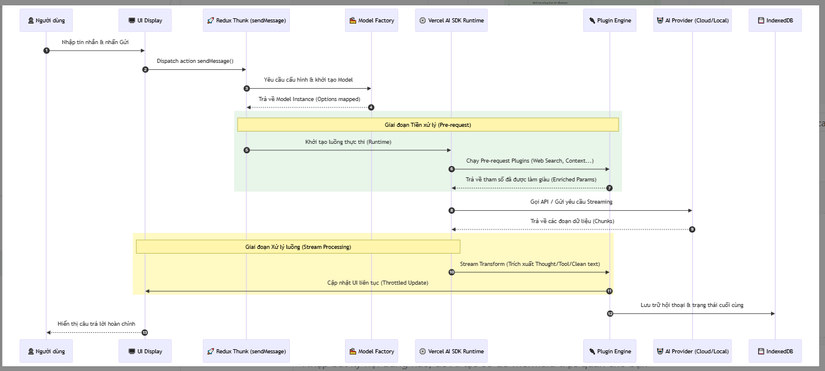

🔄 3. Phân tích chuyên sâu Luồng hoạt động (Workflow)

Quá trình xử lý một tin nhắn trong AI Core là một chuỗi các tác vụ được điều phối nghiêm ngặt:

Giải mã các kỹ thuật "Pro-level" trong mã nguồn:

- Stream Transformation (Xử lý luồng): Đây là kỹ thuật khó nhất. Khi dữ liệu đổ về, AI Core sẽ "quét" theo thời gian thực để tách biệt nội dung chính và nội dung suy nghĩ (thẻ

<thought>). Điều này cho phép UI hiển thị quá trình "tư duy" của AI tách biệt với câu trả lời cuối cùng. - Throttled UI Updates: Thay vì cập nhật giao diện ngay khi nhận được 1 token (gây treo trình duyệt nếu AI phản hồi quá nhanh), AI Core sử dụng cơ chế Throttling. Dữ liệu được gom lại và cập nhật theo chu kỳ (ms), đảm bảo mượt mà cả trên các thiết bị yếu.

- Middleware System: Tận dụng chuẩn Middleware để can thiệp vào tham số trước khi gửi đi (ví dụ: tự động chèn Context từ Web Search hoặc file PDF đã tải lên).

🔐 4. Quản lý trạng thái và Tính nhất quán

AI Core thực hiện quản lý dữ liệu đa tầng:

- Local-First Persistence: Toàn bộ lịch sử chat và cấu hình model được lưu tại IndexedDB.

- Unified Error Mapping: Chuyển đổi hàng trăm loại lỗi từ các Provider khác nhau (429 Too Many Requests, 500 Server Error...) thành một hệ thống mã lỗi nội bộ thân thiện với người dùng.

- State Synchronization: Sử dụng Redux kết hợp với cơ chế "Optimistic Updates" giúp người dùng thấy tin nhắn của mình xuất hiện ngay lập tức trước khi API phản hồi.

⚖️ 5. So sánh chiến lược

| Tiêu chí | Cherry Studio AI Core | Standard Chat Wrappers |

|---|---|---|

| Kiến trúc | Modular Runtime (TypeScript) | Direct API Calls |

| Xử lý Stream | Stream Transformation (Deep) | Basic Append |

| Thực thi Code | Local WASM (Pyodide) | Không hỗ trợ hoặc Cloud-side |

| Tính linh hoạt | Plugin-based (Extensible) | Hard-coded Logic |

✅ Kết luận: Tại sao AI Core là hình mẫu?

Cherry Studio AI Core là minh chứng cho việc làm chủ hệ sinh thái AI không chỉ là gọi API, mà là xây dựng một Runtime Environment hoàn chỉnh. Việc áp dụng Vercel AI SDK, WASM, và cơ chế Stream Processing tinh vi giúp Cherry trở thành một nền tảng mạnh mẽ, ổn định và cực kỳ dễ mở rộng. Đối với các kỹ sư Frontend/Fullstack, đây là dự án mẫu mực để nghiên cứu về xử lý dữ liệu dòng (Streaming) và kiến trúc Plugin hiện đại.

Hy vọng bản phân tích chuyên sâu này giúp bạn có thêm góc nhìn về cách xây dựng ứng dụng AI chuyên nghiệp. Đừng quên Upvote và Follow mình để đón xem những dự án kỹ thuật "xịn xò" tiếp theo!

All rights reserved