[Open Source] #236 - Context Hub (chub): Hạ tầng quản trị ngữ cảnh (Context) chuyên sâu cho AI Agents với kiến trúc Local-First, MCP Protocol và thuật toán tìm kiếm BM25

Trong kỷ nguyên lập trình được hỗ trợ bởi AI, thách thức lớn nhất không còn là viết mã mà là cung cấp đúng và đủ tri thức (Context) cho các Agent như Claude Code hay Cursor. Việc LLM bị ảo giác (hallucination) thường bắt nguồn từ dữ liệu huấn luyện đã cũ hoặc thiếu thông tin về các thư viện chuyên biệt. Context Hub ra đời như một lớp trung gian (Middleware) mạnh mẽ, cho phép quản lý, tìm kiếm và cung cấp tài liệu kỹ thuật chất lượng cao trực tiếp cho AI Agent thông qua một giao diện thống nhất và giao thức MCP chuẩn mực.

Dưới góc độ kỹ thuật, Context Hub là một minh chứng xuất sắc về việc xây dựng công cụ Agent-First, ứng dụng kỹ thuật BM25 Search Indexing tại chỗ và cơ chế Local Annotations để tạo "trí nhớ dài hạn" cho AI.

Github: https://github.com/v8u7/chub

🛠️ 1. Nền tảng công nghệ: Tối giản và Hiệu suất cho Agent

chub ưu tiên tốc độ truy xuất cực đại để không làm gián đoạn luồng suy luận của LLM:

- Logic Core (Node.js & TypeScript): Tận dụng hệ sinh thái JavaScript để xây dựng CLI linh hoạt. Toàn bộ mã nguồn được thiết kế để chạy trên Runtime Node.js 18+, đảm bảo tính tương thích cao trên mọi hệ điều hành của lập trình viên.

- AI Orchestration (MCP SDK): Tích hợp sâu giao thức Model Context Protocol của Anthropic. Điều này biến chub từ một CLI thông thường thành một "tool" bản địa có thể được AI triệu hồi ngay trong cửa sổ chat để tự tìm tài liệu.

- Search Engine (In-memory BM25): Thay vì sử dụng cơ sở dữ liệu nặng nề, chub triển khai thuật toán BM25 (thuật toán xếp hạng văn bản xác suất) trực tiếp bằng mã nguồn tinh gọn, cho phép tìm kiếm mờ (fuzzy search) hàng nghìn tài liệu ngay trên RAM với độ trễ micro-giây.

- Schema & Validation (Zod): Sử dụng Zod để ép buộc cấu trúc dữ liệu cho các đầu vào của MCP server, đảm bảo AI luôn truyền đúng tham số và nhận về kết quả chuẩn JSON.

🏗️ 2. Trụ cột kiến trúc: Agent-First và Incremental Disclosure

Kiến trúc của Context Hub được thiết kế để tối ưu hóa "Context Window" (cửa sổ ngữ cảnh) đắt đỏ của AI:

- Local-First Architecture: chub duy trì một kho lưu trữ tại

~/.chub. Tài liệu được tải về và lập chỉ mục cục bộ, cho phép Agent truy cập tri thức tức thì mà không phụ thuộc vào kết nối mạng trong quá trình thực thi logic quan trọng. - Incremental Disclosure (Tiết lộ dần dần): Đây là tư duy kỹ thuật đỉnh cao. chub hỗ trợ phân tách tài liệu thành các tệp chính và tham chiếu. Agent có thể yêu cầu lấy mô tả tổng quát trước, và chỉ khi cần đi sâu vào chi tiết API, nó mới yêu cầu fetch các file liên kết, giúp tiết kiệm hàng nghìn token lãng phí.

- Multi-source Registry: Hệ thống cho phép gộp (merge) nhiều nguồn tri thức từ GitHub CDN công khai đến các thư mục tri thức nội bộ của công ty, tạo ra một kho tài liệu hợp nhất cho toàn bộ đội ngũ kỹ thuật.

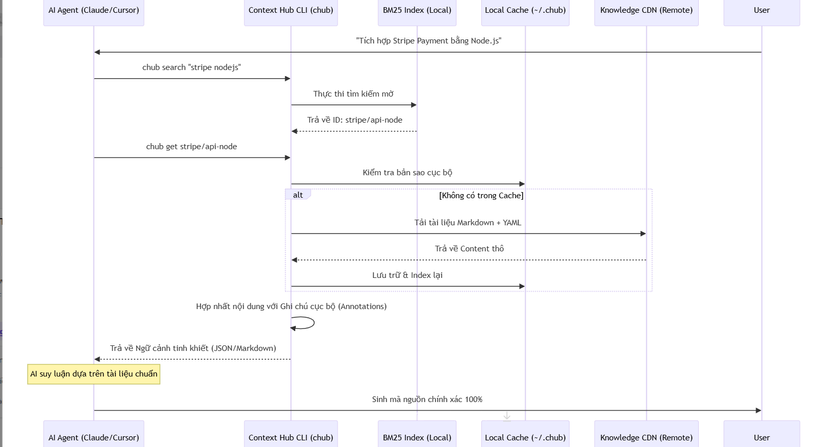

🔄 3. Workflow: Vòng đời từ Tri thức đến Mã nguồn (Sequence Diagram)

Sơ đồ mô tả quy trình AI Agent điều phối việc lấy ngữ cảnh từ chub để thực hiện lập trình:

⚡ 4. Các kỹ thuật "Pro-level" trong mã nguồn

- Local Context Augmentation (Annotations): chub cho phép Agent tự "ghi chú" lại các kinh nghiệm thực tế tại

~/.chub/annotations/. Ví dụ: nếu một API có bug, Agent có thể lưu lại và ở lần truy cập sau, chub sẽ tự động nhúng ghi chú này vào tài liệu, giúp AI không lặp lại sai lầm cũ. - Stateless Feedback Loop: Tích hợp hệ thống telemetry ẩn danh. chub tạo ra một định danh duy nhất cho máy tính dựa trên mã băm phần cứng, cho phép tác giả tài liệu nhận được phản hồi về chất lượng (Feedback) mà không cần thu thập thông tin cá nhân của lập trình viên.

- Cross-platform Directory Standards: Tuân thủ các chuẩn lưu trữ như XDG Base Directory trên Linux và AppData trên Windows, đảm bảo cấu trúc tệp tin của chub luôn ngăn nắp và dễ dàng quản lý bởi các công cụ backup hệ thống.

- CLI-Machine Synergy: Mọi lệnh của chub đều hỗ trợ đầu ra

--json. Đây là kỹ thuật then chốt để các công cụ tự động hóa có thể "pipe" tri thức qua lại, biến tri thức thành một dòng chảy dữ liệu có thể lập trình được.

⚖️ 5. So sánh chiến lược

| Tiêu chí | Context Hub (chub) | Tài liệu trực tuyến (SaaS) | RAG thủ công (Embeddings) |

|---|---|---|---|

| Tốc độ truy xuất | Cực nhanh (Local-first) | Chậm (Network latency) | Trung bình |

| Độ chính xác | Tuyệt đối (Source of Truth) | Trung bình (Dễ bị loãng) | Thấp (Dễ bị ảo giác) |

| Giao tiếp AI | Native (MCP Protocol) | Phải Copy-Paste | Qua API Vector |

| Trí nhớ dài hạn | Có (Local Annotations) | Không | Có |

| Tính riêng tư | Rất cao | Thấp | Trung bình |

✅ Kết luận: Tại sao Context Hub là hạ tầng tri thức tương lai?

Context Hub chứng minh rằng tri thức không nên chỉ nằm ở trên Web, nó phải nằm ở nơi AI Agent thực thi. Bằng cách làm chủ kỹ thuật Local Indexing và tích hợp chuẩn MCP, dự án đã tạo ra một hệ sinh thái giúp AI không chỉ thông minh hơn mà còn "thực tế" hơn trong từng dòng code được tạo ra.

Đối với các kỹ sư Backend và AI, nghiên cứu dự án này mang lại giá trị về:

- Kỹ thuật xây dựng CLI cho AI Agents tiêu thụ.

- Cách triển khai MCP Protocol cho các hệ thống tri thức.

- Tư duy thiết kế hệ thống tài liệu hướng Agent (Agent-readable docs).

All rights reserved