[Open Source] #229 - Promptfoo: Bộ công cụ kiểm thử và Red Teaming LLM chuyên sâu với kiến trúc TypeScript, SQLite và cơ chế Model-Graded Evaluation

Việc đưa các mô hình ngôn ngữ lớn (LLM) vào sản xuất (production) luôn đi kèm với rủi ro về chất lượng phản hồi và các lỗ hổng bảo mật mới như Prompt Injection hay Jailbreaking. Promptfoo ra đời như một hạ tầng kiểm thử tối thượng, cho phép các kỹ sư AI đánh giá hiệu năng prompt, so sánh các mô hình và thực hiện Red Teaming tự động. Điểm vượt trội của dự án nằm ở triết lý Local-first, giúp doanh nghiệp kiểm thử dữ liệu nhạy cảm mà không lo rò rỉ thông tin ra bên ngoài.

Dưới góc độ kỹ thuật, Promptfoo là một minh chứng xuất sắc về việc ứng dụng kiến trúc Provider Abstraction, kỹ thuật Model-graded Evaluation và hệ thống điều phối kiểm thử quy mô lớn bằng TypeScript.

Github: https://github.com/promptfoo/promptfoo

🛠️ 1. Nền tảng công nghệ: Hiệu năng và Tính an toàn kiểu dữ liệu

Dự án chọn lọc những công nghệ hiện đại nhất để đảm bảo quy trình kiểm thử diễn ra nhanh chóng và chính xác:

- Logic Core (TypeScript & Node.js 20+): Sử dụng TypeScript để quản lý các cấu trúc cấu hình (YAML/JSON) phức tạp của hàng trăm loại test case, đảm bảo tính an toàn kiểu dữ liệu (Type-safety) tuyệt đối.

- Persistent & Migration (SQLite & Drizzle ORM): Toàn bộ kết quả đánh giá được lưu trữ bền vững tại SQLite cục bộ thông qua Drizzle ORM, cho phép truy vấn lịch sử kiểm thử cực nhanh mà không cần cài đặt server database cồng kềnh.

- Build System (tsdown & esbuild): Sử dụng các công cụ đóng gói siêu tốc giúp CLI khởi động tức thì và hỗ trợ nạp các script tùy chỉnh của người dùng tại thời điểm runtime.

- Modern Dashboard (React 19 & Vite): Cung cấp giao diện trực quan hóa kết quả kiểm thử dưới dạng ma trận (Matrix View), giúp so sánh sự khác biệt giữa các phiên bản prompt một cách dễ dàng.

🏗️ 2. Trụ cột kiến trúc: Provider Abstraction và Declarative Testing

Kiến trúc của Promptfoo được thiết kế để trở thành một trung tâm điều phối (Orchestrator) vạn năng:

- Provider Abstraction Layer: Hệ thống định nghĩa một lớp giao tiếp chuẩn (Interface) cho mọi mô hình AI. Bạn có thể kết nối từ các API đám mây (OpenAI, Anthropic) đến các mô hình chạy cục bộ (Ollama) hoặc thậm chí là các API nội bộ viết bằng Python/Go chỉ thông qua việc cấu hình một bộ chuyển đổi.

- Declarative Testing (Cấu hình dạng khai báo): Mọi kịch bản kiểm thử, biến đầu vào và tiêu chí xác nhận (Assertions) đều được định nghĩa trong file YAML. Tư duy này giúp quy trình kiểm thử AI có thể được phiên bản hóa (Git) và tích hợp hoàn hảo vào luồng CI/CD.

- Red Teaming Engine: Đây là module chuyên sâu dành cho bảo mật. Promptfoo tự động hóa các kỹ thuật tấn công thử nghiệm bằng cách sinh ra các dữ liệu đối kháng (adversarial data) để tìm kiếm các lỗ hổng như rò rỉ thông tin cá nhân (PII) hay khả năng bị bẻ khóa (Jailbreak).

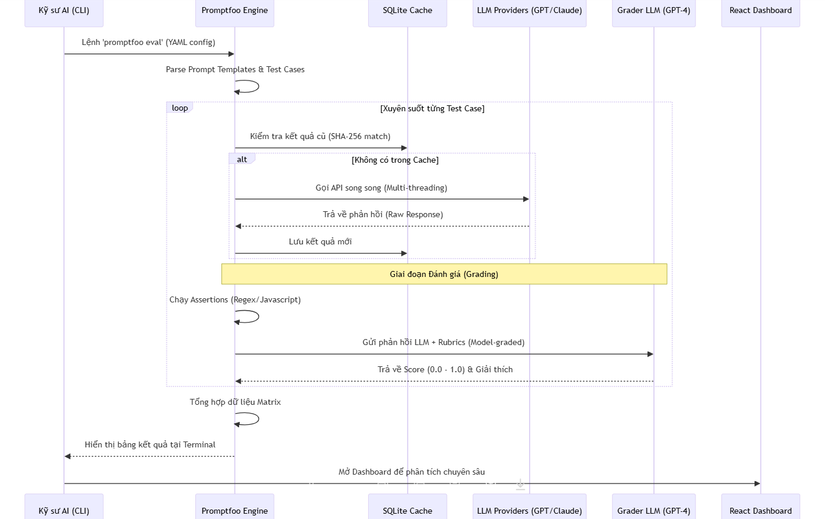

🔄 3. Workflow: Vòng đời của một chu kỳ Đánh giá Prompt (Sequence Diagram)

Sơ đồ mô tả quy trình hệ thống điều phối các yêu cầu song song đến nhiều mô hình để chấm điểm:

⚡ 4. Các kỹ thuật "Pro-level" trong mã nguồn

- Model-Graded Evaluations: Thay vì chỉ so khớp văn bản (vốn không hiệu quả với AI), Promptfoo sử dụng một "LLM thẩm định" (thường là GPT-4) để chấm điểm câu trả lời của mô hình đang thử nghiệm dựa trên các tiêu chí ngữ nghĩa phức tạp.

- Red Team Adversarial Generation: Tích hợp bộ máy tự động tạo prompt tấn công. Hệ thống sử dụng các thuật toán sinh dữ liệu để tìm ra các từ khóa "mồi" có khả năng làm mô hình vi phạm chính sách an toàn, giúp phát hiện lỗ hổng trước khi hacker tìm thấy.

- Sandwich Parsing Logic: Kỹ thuật bóc tách dữ liệu từ phản hồi của LLM một cách bền bỉ: hệ thống tự động tìm kiếm các cặp thẻ (tags) xa nhất để trích xuất JSON hoặc mã nguồn, giúp bỏ qua các đoạn văn bản giải thích dư thừa của AI.

- Dynamic Module Loading: Cho phép người dùng viết các hàm kiểm tra (assertions) bằng JavaScript hoặc Python. Promptfoo sử dụng

import()động để nạp các logic này vào quy trình đánh giá mà không làm giảm hiệu suất của engine lõi.

⚖️ 5. So sánh chiến lược

| Tiêu chí | Promptfoo | LangSmith (SaaS) | OpenAI Evals |

|---|---|---|---|

| Quyền riêng tư | Tuyệt đối (Chạy Local 100%) | Thấp (Dữ liệu lên Cloud) | Thấp |

| Bảo mật | Có chuyên module Red Teaming | Không chuyên sâu | Cơ bản |

| Tính linh hoạt | Rất cao (Đa ngôn ngữ/đa mô hình) | Cao (Chỉ JS/Python) | Chỉ OpenAI |

| Hạ tầng | SQLite nhẹ nhàng | Cloud-dependent | N/A |

| Chi phí | Miễn phí (Mã nguồn mở) | Trả phí theo lưu lượng | Miễn phí |

✅ Kết luận: Tại sao Promptfoo là hình mẫu cho LLM-Ops?

Promptfoo chứng minh rằng việc đưa AI vào sản xuất không thể dựa trên cảm tính. Bằng cách xây dựng một hạ tầng kiểm thử chặt chẽ, tự động hóa và bảo mật, dự án đã cung cấp một công cụ thiết yếu để biến các prompt AI từ "nghệ thuật" thành một quy trình kỹ thuật có thể đo lường được.

Đối với các kỹ sư AI và Backend, nghiên cứu Promptfoo giúp bạn hiểu sâu về:

- Kỹ thuật điều phối API LLM song song hiệu quả.

- Cách xây dựng hệ thống Red Teaming bảo vệ ứng dụng AI.

- Tư duy thiết kế Provider Pattern để tích hợp hàng trăm dịch vụ bên thứ ba.

All rights reserved