[Open Source] #208 - LlamaIndex: Hệ điều hành dữ liệu cho AI Agent với kiến trúc RAG chuyên sâu và cơ chế Event-driven Workflows

Trong kỷ nguyên của các mô hình ngôn ngữ lớn (LLM), bài toán thách thức nhất không phải là huấn luyện mô hình, mà là làm thế nào để kết nối trí tuệ của AI với dữ liệu riêng tư, hỗn loạn của doanh nghiệp một cách chính xác và bảo mật. LlamaIndex ra đời như một hạ tầng dữ liệu (Data Framework) tối thượng, cung cấp các bộ công cụ để nạp, cấu trúc hóa và truy xuất tri thức cho các ứng dụng LLM. Điểm vượt trội của LlamaIndex nằm ở khả năng biến các tệp tin tĩnh (PDF, SQL, Slack) thành một hệ sinh thái tri thức động, cho phép AI không chỉ trả lời câu hỏi mà còn có thể suy luận và thực thi tác vụ phức tạp thông qua cơ chế Agentic RAG.

Dưới góc độ kỹ thuật, LlamaIndex là một minh chứng xuất sắc về việc ứng dụng Kiến trúc hướng sự kiện (Event-Driven), kỹ thuật Trừu tượng hóa dữ liệu đa tầng và hệ thống điều phối tác vụ AI bền bỉ.

Github: https://github.com/run-llama/llama_index

🛠️ 1. Nền tảng công nghệ: Trái tim của RAG hiện đại

LlamaIndex xây dựng một ngăn xếp công nghệ tập trung vào việc tối ưu hóa "ngữ cảnh" cho LLM:

- RAG Engine (Retrieval-Augmented Generation): Xương sống của dự án, cho phép mô hình truy xuất dữ liệu thời gian thực từ các nguồn bên ngoài trước khi tạo câu trả lời, giúp triệt tiêu hiện tượng "ảo giác" (hallucination).

- Vector Database Orchestration: Tích hợp sâu với hơn 20 kho lưu trữ vector (Pinecone, Milvus, Qdrant) để thực hiện tìm kiếm tương đồng ngữ nghĩa (Semantic Search) trên hàng tỷ đoạn dữ liệu.

- LlamaParse (Agentic OCR): Một kỹ thuật đột phá sử dụng AI để "đọc" và phân tích cấu trúc tài liệu phức tạp (như bảng biểu, sơ đồ trong PDF) mà các phương pháp truyền thống thường bỏ sót.

- Advanced LLM Connectors: Hỗ trợ đa nền tảng thông qua bộ API nhất quán, cho phép hoán đổi linh hoạt giữa OpenAI, Anthropic, Gemini hoặc các mô hình chạy cục bộ (Ollama) chỉ bằng một dòng cấu hình.

🏗️ 2. Trụ cột kiến trúc: Modular Core và Event-driven Workflows

Kiến trúc của LlamaIndex được thiết kế để mở rộng ở quy mô công nghiệp:

- Decoupled Integration Model: Dự án tách biệt hoàn toàn phần lõi (

llama-index-core) chứa các interface chuẩn, khỏi hàng trăm gói tích hợp (integrations). Cách tiếp cận này giúp hệ thống cực kỳ nhẹ nhàng nhưng có khả năng mở rộng vô hạn. - Event-Driven Workflows: Đây là bước tiến lớn của phiên bản mới. LlamaIndex chuyển từ các chuỗi (Chains) tuyến tính cứng nhắc sang luồng công việc dựa trên sự kiện. Các bước xử lý AI giao tiếp với nhau bằng

Events, cho phép xây dựng các Agent có khả năng tự sửa lỗi và xử lý các luồng logic rẽ nhánh phức tạp. - Data Hierarchy (Document-Node-Index): Hệ thống phân cấp dữ liệu khoa học:

- Document: Nguồn dữ liệu thô ban đầu.

- Node: Các mảnh tri thức nhỏ (Chunks) được đính kèm Metadata phong phú.

- Index: Cấu trúc toán học tối ưu để AI tìm kiếm tri thức nhanh nhất.

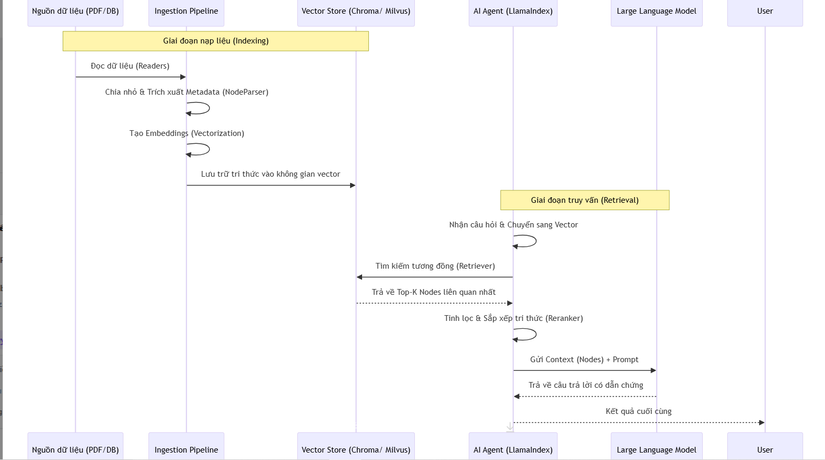

🔄 3. Workflow: Vòng đời từ Dữ liệu thô đến Tri thức AI (Sequence Diagram)

Sơ đồ mô tả quy trình LlamaIndex điều phối luồng dữ liệu RAG:

⚡ 4. Các kỹ thuật "Pro-level" trong mã nguồn

- Pydantic-driven Validation: Toàn bộ dữ liệu đầu vào và đầu ra của hệ thống được kiểm soát nghiêm ngặt bởi Pydantic v2. Kỹ thuật này đảm bảo tính an toàn kiểu dữ liệu (Type-safety) tuyệt đối, giúp phát hiện lỗi cấu hình ngay từ giai đoạn lập trình.

- Fully Asynchronous Orchestration: Hầu hết các phương thức quan trọng đều hỗ trợ

async/await. Điều này cực kỳ quan trọng đối với ứng dụng AI vì phần lớn thời gian hệ thống phải đợi phản hồi I/O từ các API đám mây. - Stateful Memory Management: Agent của LlamaIndex sử dụng bộ nhớ trạng thái (Memory) có khả năng Serialize. AI có thể lưu trữ và khôi phục ngữ cảnh hội thoại từ Database, cho phép xây dựng các chatbot có trí nhớ dài hạn.

- Metadata Filtering & Hybrid Search: Kỹ thuật kết hợp tìm kiếm từ khóa truyền thống (BM25) và tìm kiếm vector (Semantic), giúp tăng độ chính xác của kết quả truy xuất lên gấp nhiều lần so với chỉ dùng vector đơn thuần.

⚖️ 5. So sánh chiến lược

| Tiêu chí | LlamaIndex | LangChain | Tự viết mã nguồn (Raw API) |

|---|---|---|---|

| Thế mạnh chính | Quản trị Dữ liệu & RAG | Tính linh hoạt & Chains | Tốc độ & Kiểm soát |

| Kiến trúc | Data-Centric (Hướng dữ liệu) | Action-Centric (Hướng hành động) | Phân tán |

| Độ khó sử dụng | Thấp (Nhiều abstractions) | Trung bình | Rất cao |

| Xử lý tài liệu | Đỉnh cao (LlamaParse) | Cơ bản | Thủ công |

| Agentic AI | Rất mạnh (Event-driven) | Mạnh (LangGraph) | Tùy biến |

✅ Kết luận: Tại sao LlamaIndex là hạ tầng không thể thiếu cho AI?

LlamaIndex không chỉ là một thư viện; nó là một hệ điều hành dữ liệu cho kỷ nguyên AI. Bằng cách làm chủ các kỹ thuật cấu trúc hóa tri thức và xây dựng một hệ thống điều phối hướng sự kiện bền bỉ, dự án đã giải quyết triệt để bài toán đưa dữ liệu thực tế vào mô hình ngôn ngữ.

Đối với các kỹ sư AI và Backend, nghiên cứu LlamaIndex mang lại giá trị về:

- Kỹ thuật xây dựng Hệ thống RAG cấp độ doanh nghiệp.

- Cách quản lý Dữ liệu Vector và Metadata ở quy mô lớn.

- Tư duy thiết kế AI Agent dựa trên kiến trúc hướng sự kiện (EDA).

All rights reserved